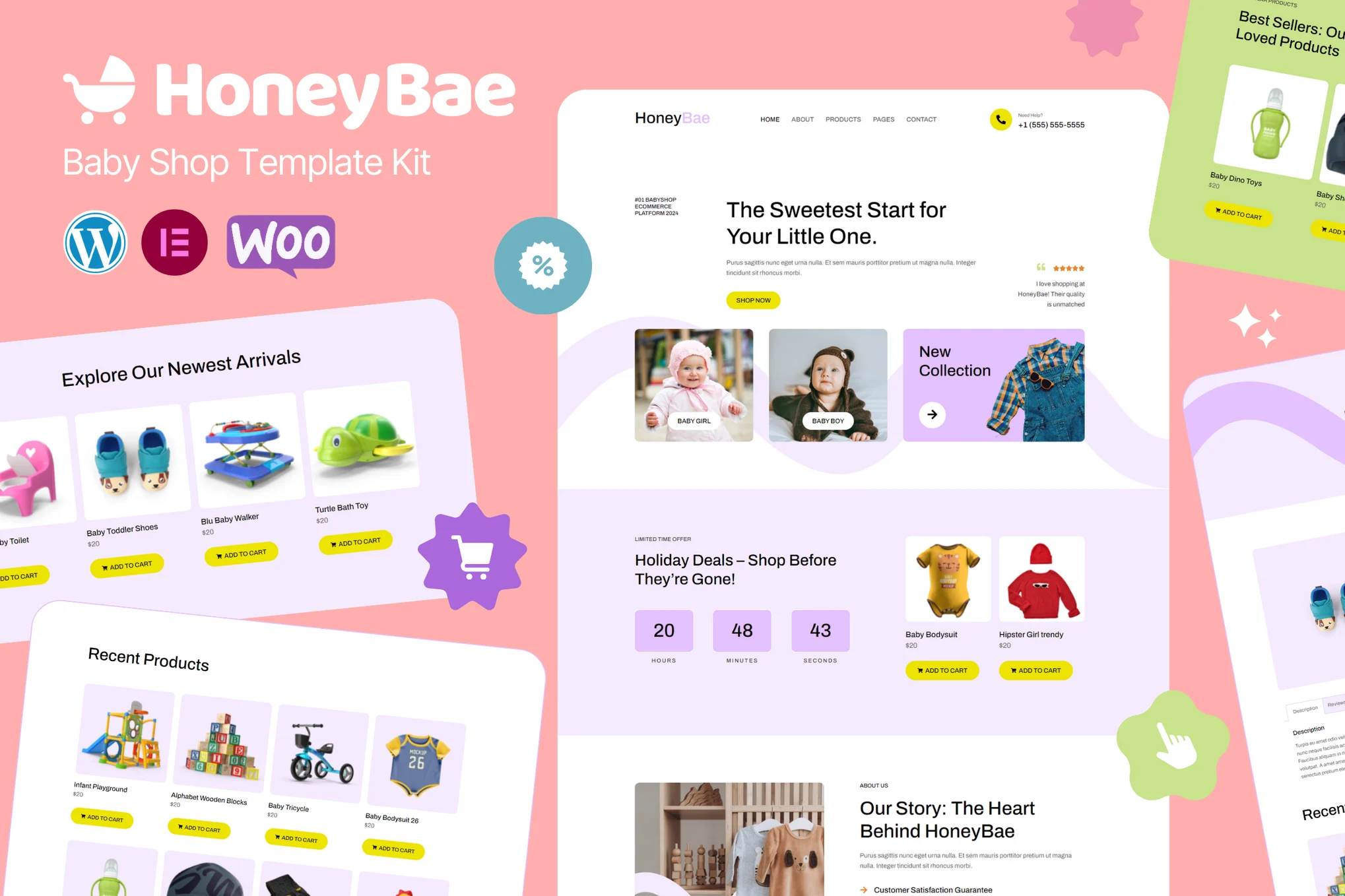

Si desea controlarAcceso de los motores de búsqueda a los sitios webCree robots.txt es el primer paso. Se trata de un archivo de texto ASCII que indica al motor de búsqueda qué páginas pueden indexarse y cuáles no.

Edición correcta robots.txt Los archivos pueden tener un impacto significativo en el SEO de un sitio, ayudar a mejorar la visibilidad del sitio y también proteger los archivos confidenciales.

![Imagen [1] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20241211110551311-image.png)

¿Qué es un archivo robots.txt?

robots.txt es un archivo de reglas para los rastreadores de los motores de búsqueda, que define qué partes de un sitio web están abiertas a los rastreadores y qué partes están fuera de los límites. Con una configuración adecuada, podrá gestionar mejor la estrategia de indexación de contenidos de su sitio web.

¿Cómo crear y personalizar el archivo robots.txt?

1. Comprensión robots.txt Reglas básicas de sintaxis para documentos.

2. Añada reglas que permitan o prohíban según las necesidades del sitio.

3. Suba el archivo al directorio raíz del sitio web para garantizar que los motores de búsqueda puedan leerlo correctamente.

¿Qué es el archivo robots.txt?

robots.txt es un simple archivo de texto que se utiliza para enviar un mensaje alrastreador web(por ejemplo, los robots de los motores de búsqueda) indican qué partes de un sitio web pueden rastrearse y qué partes deben ocultarse. Garantiza que los motores de búsqueda no indexen páginas o archivos que no deben hacerse públicos, protegiendo así la privacidad del sitio y la seguridad del contenido.

Por defecto, WordPress genera automáticamente un robots.txt con la ruta:www.yourdomain.com/robots.txt. Al crear un robots.txt puede sustituir el archivo predeterminado y controlar así con mayor precisión qué archivos o páginas no son indexados por los motores de búsqueda.

![Imagen [2] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20241211101429813-image.png)

Ubicación del archivo robots.txt de WordPress

robots.txt El archivo se encuentra normalmente en el directorio raíz del sitio web.WordPress genera automáticamente una versión virtual del archivo robots.txt pero si no lo crea manualmente, el archivo no se guardará realmente en el servidor.

¿Cómo ver el archivo robots.txt de un sitio web?

1. Abra su navegador.

2. En la barra de direcciones, escriba https://您的域名/robots.txt Y visítenos.

- Si el archivo existe, el navegador muestra robots.txt El contenido del archivo.

![Imagen [3] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20241211103133758-image.png)

- Si no aparece ningún contenido, el sitio aún no se ha creado robots.txt Documentación.

Esto puede hacerse creando un robots.txt para gestionar con precisión el acceso de los motores de búsqueda al contenido del sitio web.

Comprender las reglas del archivo robots.txt

robots.txt Las directivas del archivo definen el comportamiento de un rastreador web (por ejemplo, un robot de un motor de búsqueda). Las directivas constan de dos partes principales:

1. Agente de usuario: Especifica a qué rastreador (por ejemplo, Googlebot) se aplica la regla.

2. No permitir: Especifica qué páginas o directorios no se pueden rastrear.

Ejemplo:

User-agent: *

Disallow: /wp-admin/Este código ordena a todos los rastreadores que desactiven el rastreo /wp-admin/ catálogo, pero se puede acceder a otras áreas con normalidad.

Comprender y utilizar correctamente robots.txt Las reglas del archivo son fundamentales. Una configuración incorrecta puede tener consecuencias no deseadas, como impedir que los motores de búsqueda accedan a páginas importantes del sitio.

Éstos son algunos de los más comunes robots.txt Una breve descripción de las normas y sus usos:

| normas y reglamentos | instrucciones |

|---|---|

| Agente de usuario: * | Especifica que las siguientes reglas se aplican a todos los rastreadores. |

| Disallow: / | Deshabilite el acceso de todos los rastreadores a cualquier página del sitio. |

| Disallow: /privado/ | Bloquear todo acceso de rastreadores /privado/ Todas las páginas del directorio. |

| Permitir: /public/ | Permitir el acceso a todos los rastreadores /público/ Todas las páginas del directorio. |

| Mapa del sitio: https://www.example.com/sitemap.xml | Especifique la ubicación del archivo Sitemap del sitio web, para que los rastreadores puedan indexar mejor el contenido. |

Configurando adecuadamente estas reglas, podrá gestionar mejor el comportamiento de los rastreadores y mejorar los resultados SEO, protegiendo al mismo tiempo la privacidad de los contenidos sensibles.

Cómo crear el archivo robots.txt de WordPress

La creación de un archivo robots.txt puede hacerse de varias maneras, pero en este post se presentan 2 métodos sencillos:

Método 1: Editar el archivo robots.txt con el plugin

se parecen a WPCode responder cantando Robots.txt virtuales Estos plugins pueden gestionarse fácilmente sin tener que escribir código directamente robots.txt Documentación. Basta con instalar el plugin, ir a su pantalla de configuración y añadir reglas personalizadas. Este método es fácil de usar y perfecto para los novatos.

Edición del archivo robots.txt con WPCode

1. En el panel de control de WordPress Plugins > Instalar Plugins página, busque e instale WPCode Complementos.

![Imagen [4] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20241211103814194-image.png)

2. Una vez finalizada la instalación, vaya a Fragmentos de código y, a continuación, haga clic en Editor de archivos.

![Imagen [5] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20241211103822804-image.png)

3. En Editor de archivos En el robots.txt Opciones de archivo.

4. Modifique el contenido del documento de acuerdo con los requisitos, guarde los cambios y pruébelos.

Edición del archivo robots.txt con Virtual Robots.txt

1. En Plugins > Instalar Plugins página, busque e instale Robots.txt virtuales Complementos.

![Imagen [6] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20241211103920795-image.png)

2. Una vez completada la instalación, vaya a la página del plugin establecer Página.

![Imagen [7] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20241211103938540-image.png)

3. Vea las reglas predeterminadas que proporciona el complemento o añada reglas personalizadas según sea necesario.

4. Guarde los cambios y asegúrese de que robots.txt El documento responde a sus necesidades.

![Imagen [8] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20241211103954185-image.png)

El uso de estos complementos facilita la gestión robots.txt archivos, adaptándose a las necesidades de los distintos sitios web, al tiempo que se garantiza un control adecuado del comportamiento de los rastreadores de los motores de búsqueda.

Método 2: Crear y subir el archivo robots.txt de WordPress a través de FTP

Para un control más directo robots.txt puede crear un archivo físico con un editor de texto y subirlo mediante FTP. Estos son los pasos exactos:

Crear archivo robots.txt

1. Abra un editor de texto (por ejemplo, el Bloc de notas u otra herramienta conocida).

2. Preparación de las normas necesarias. Por ejemplo:

![Imagen [9] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20241211104156411-image.png)

3. Guarde el documento como robots.txt.

Subir al directorio raíz del sitio web

1. Utilice una utilidad FTP (p. ej. FileZilla) o un panel de control (p. ej.pagodaetc.) para conectarse al servidor web.

2. Navegue hasta el directorio raíz del sitio (normalmente el directorio public_html tal vez www (carpeta).

![Imagen [10] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20241211104423814-image.png)

3. Coloque el robots.txt El archivo se carga en el directorio raíz.

Al finalizar. robots.txt El archivo entrará en vigor y se podrá acceder a él yendo a https://您的域名/robots.txt para verificar que el contenido del fichero se muestra correctamente. De este modo, el contenido y las reglas del fichero pueden controlarse por completo.

Añadir reglas al robots.txt de WordPress

crear una buena idea robots.txt Después del archivo, se pueden añadir varias reglas según sea necesario para lograr objetivos específicos. A continuación se indican algunos usos comunes y ejemplos de código:

1. Bloquear todo el sitio para que no sea rastreado

existe robots.txt El siguiente código se añade al archivo para impedir que los motores de búsqueda rastreen todo el sitio:

Agente de usuario: *

Disallow: /2. Bloquear el acceso al sitio de rastreadores específicos

Añada el siguiente código para bloquear el acceso al sitio de un rastreador específico (por ejemplo, Dotbot):

User-agent: Dotbot

Disallow: /3. Bloquear carpetas o archivos específicos para que no sean rastreados

El siguiente código impide que los motores de búsqueda rastreen una carpeta o un archivo concreto:

Agente de usuario: *

Disallow: /carpeta-privada/

4. Permita que todos los rastreadores accedan al sitio

El siguiente código permite a todos los rastreadores acceder a todo el contenido del sitio:

Agente de usuario: *

Disallow.5. Permitir el acceso a archivos específicos en carpetas prohibidas

El siguiente código permite al rastreador acceder a archivos específicos de la carpeta prohibida:

Agente de usuario: *

Disallow: /carpeta-privada/

Permitir: /carpeta-privada/archivo-público.html

6. Bloquear el rastreo de la página de resultados de búsqueda de WordPress

El siguiente código impide que el rastreador rastree la página de resultados de búsqueda de WordPress:

User-agent: *

Disallow: /?s=7. Establezca reglas diferentes para los distintos rastreadores

El siguiente código establece diferentes reglas para diferentes rastreadores:

User-agent: Googlebot

Disallow: /no-google/

Usuario-agente: Bingbot

Disallow: /no-bing/8. Bloqueo de GPTBot para que no rastree el contenido del sitio web

El siguiente código impide que GPTBot rastree el contenido de su sitio web:

User-agent: GPTBot

Disallow: /Estos ejemplos demuestran la robots.txt Las normas pueden adaptarse con flexibilidad a la estrategia SEO de un sitio para gestionar mejor el comportamiento de los motores de búsqueda, proteger el contenido del sitio y optimizar las clasificaciones de búsqueda.

![Imagen [11] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20250118094142256-image.png)

Especifique el agente de usuario en el archivo robots.txt

Las reglas pueden configurarse para dirigirse a rastreadores específicos especificando un agente de usuario en la regla. Además, el uso de comodines puede ayudar a gestionar de forma más flexible el acceso de los rastreadores a distintas partes del sitio.

1. Utilice comodines en el archivo robots.txt

Los comodines pueden establecer reglas amplias o específicas basadas en patrones.

2. Uso de comodines asterisco (*)

Un asterisco (*) indica cualquier agente de usuario y se aplica a todos los rastreadores:

User-agent: *

Disallow: /privado/3. Uso de comodines con el signo del dólar ($)

El signo del dólar ($) indica el final de la URL y se utiliza para coincidir con un patrón de URL específico:

Agente de usuario: *

Disallow: /*? /*?Cómo comprobar el archivo robots.txt

Al crear o editar robots.txt Es muy importante verificar la exactitud del archivo inmediatamente después de crearlo. Esto puede verificarse utilizando las siguientes herramientas:

1. Consola de búsqueda de Google

presentar (un informe, etc.) robots.txt documento y compruebe el cumplimiento de las normas previstas.

2. Herramientas de validación dedicadas

utilice una herramienta como technicalseo.com Tales herramientas en línea para la verificación.

Pasos de validación:

1. Introduzca la URL del sitio web (por ejemplo https://yourdomain.com/robots.txt).

2. Seleccione el rastreador o agente de usuario que le interese en el menú desplegable.

3. Pulse presentar (un informe, etc.) para iniciar la validación.

Tras completar estos pasos, es fácil confirmar robots.txt está configurado correctamente, garantizando así que el rastreador se ejecuta de acuerdo con las reglas establecidas.

![Imagen [12] - Cómo gestionar y optimizar los archivos robots.txt para sitios web WordPress: una guía completa](https://www.361sale.com/wp-content/uploads/2024/12/20241211110018817-image.png)

resúmenes

gestionar bien robots.txt La documentación es una parte importante de la optimización SEO de su sitio web WordPress. Siguiendo las pautas anteriores, es posible crear una robots.txt tanto para mejorar la visibilidad de su sitio web como para proteger las zonas sensibles de su sitio web contra el rastreo.

| Contacte con nosotros | |

|---|---|

| ¿No puede leer el tutorial? Póngase en contacto con nosotros para obtener una respuesta gratuita. Ayuda gratuita para sitios personales y de pequeñas empresas |

Servicio de atención al cliente WeChat

|

| ① Tel: 020-2206-9892 | |

| ② QQ咨询:1025174874 | |

| (iii) Correo electrónico: info@361sale.com | |

| ④ Horario de trabajo: de lunes a viernes, de 9:30 a 18:30, días festivos libres | |

Enlace a este artículo:https://www.361sale.com/es/30070El artículo está protegido por derechos de autor y debe ser reproducido con atribución.

![Emoji[wozuimei]-Photonflux.com | Servicio profesional de reparación de WordPress, en todo el mundo, respuesta rápida](https://www.361sale.com/wp-content/themes/zibll/img/smilies/wozuimei.gif)

![Emoticono [baoquan] - Photon Wave Network | Servicios profesionales de reparación de WordPress, cobertura mundial, respuesta rápida](https://www.361sale.com/wp-content/themes/zibll/img/smilies/baoquan.gif)

Sin comentarios