検索エンジンにあなたのことをもっと知ってもらいたいワードプレスウェブサイト?robots.txtファイルを適切に設定することが重要です! この目立たないファイルは、ウェブサイトの地図ナビゲーションのようなもので、検索エンジンが重要なコンテンツをクロールし、無関係なページを避けるようにインテリジェントに誘導することができ、サーバーの負担を軽減し、SEOの結果を改善することができます。この記事ではヨーストSEOこのプラグインは、クローラーが正確にクロールできるようにrobots.txtを簡単に設定し、ウェブサイトのインクルード効果を最適化します。

![画像[1]-Yoast SEO with robots.txt:クローラーのルールを正しく設定するには?](https://www.361sale.com/wp-content/uploads/2025/06/20250630135315420-image.png)

1.robots.txtとは何ですか?

robots.txt これは、ウェブサイトのルート・ディレクトリにあるプレーン・テキスト・ファイルで、検索エンジンのクローラーに、どのページがクロール可能で、どのページがクロール禁止かを伝えるために使用される。

基本的な構文は以下の通り:

ユーザーエージェント:[クローラー名]

Disallow:[クロールを禁止するパス]

許可: [許可されたパス]例

ユーザーエージェント: *

許可しない: /wp-admin/

許可: /wp-admin/admin-ajax.phpこれは、すべてのクローラーがwp-adminバックエンドをクロールすることは禁止されているが、admin-ajax.phpファイルをクロールすることは許可されていることを意味します。

2.なぜrobots.txtの設定が重要なのですか?

- クローリングの効率化

クローラーが重複ページや価値のないページでクロール予算を浪費するのを防ぐ。

- プライベート・コンテンツの保護

検索エンジンがバックエンドやシステムファイルなどの機密性の高いパスにアクセスするのをブロックする。

- 重複コンテンツの混入を防ぐ

noindexと併用することで、重複ページや無意味なページの影響を避けることができる。 SEO.

しかし、robots.txtはあくまでもクローラーに対する「リクエスト」であり、悪意のあるクローラーの中にはそのルールを無視するものもいることに注意しよう。

3.robots.txtに関連するYoast SEO

Yoast SEO自体はrobots.txtファイルを直接生成しませんが、robots.txtを編集するための便利なエントリーポイントを提供しています。 ファイル転送プロトコル サーバーファイルを修正する。

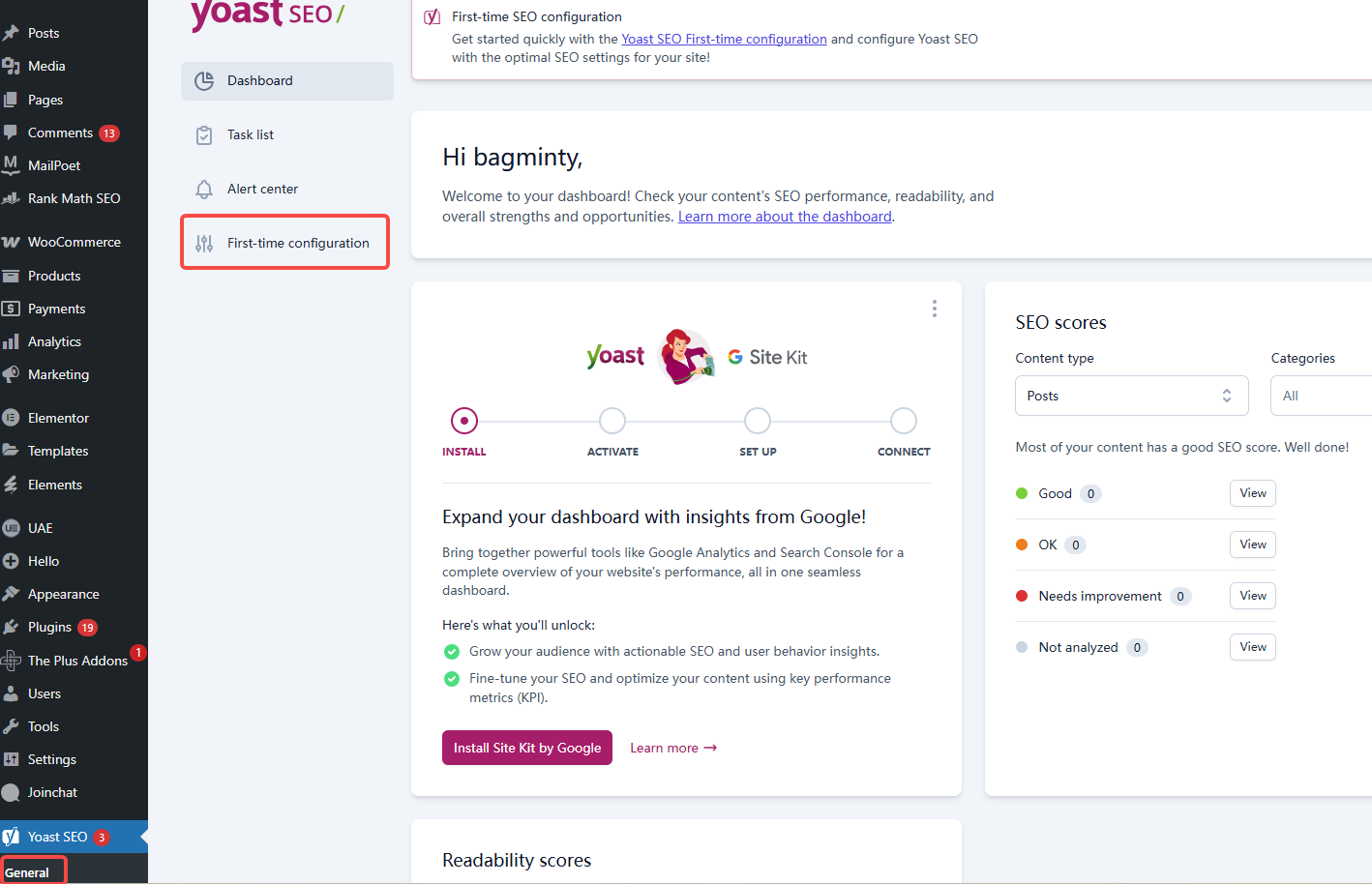

Yoast SEOでrobots.txtを編集するには?

- WordPressバックエンドにログイン

- 左メニューのYoast SEO > Toolsをクリックします。

![画像[2]-Yoast SEO with robots.txt:クローラーのルールを正しく設定するには?](https://www.361sale.com/wp-content/uploads/2025/06/20250630135842634-image.png)

- ファイルエディタを選択

![画像[3]-Yoast SEO with robots.txt:クローラーのルールを正しく設定するには?](https://www.361sale.com/wp-content/uploads/2025/06/20250630135911851-image.png)

- もし ワードプレス 書き込み権限があれば、robots.txtの編集ボックスが表示されます。

![画像[4]-Yoast SEO with robots.txt:クローラーのルールを正しく設定するには?](https://www.361sale.com/wp-content/uploads/2025/06/20250630135933982-image.png)

- クローラーのルールをここに入力し、[変更を保存]をクリックすると有効になります!

プロンプトを編集できない場合は、FTPまたはホスティングコントロールパネルを介して手動でrobots.txtファイルを作成する必要があります。

4.robots.txt設定の一般的な例

以下はWordPressのrobots.txtの一般的な設定例で、サイトの構造に合わせて変更することができます:

4.1 基本構成

ユーザーエージェント: *

許可しない: /wp-admin/

許可: /wp-admin/admin-ajax.phpこのコンフィギュレーションでは、クローラーはバックエンドのディレクトリをクロールしないが エイジャックス 資料請求

4.2 プラグイン・ディレクトリをマスクする

プラグインディレクトリを非表示にしたい場合は、追加してください:

許可しない: /wp-content/plugins/しかし、これらのパスがフロントエンドの機能に影響を与えないと判断されない限り、これらを完全に無効にすることは一般的に推奨されません。

4.3 完全なキャプチャを許可する

クローラーにサイトのすべてのコンテンツをクロールさせたい場合:

ユーザーエージェント: *

不許可4.4 マスキングタグと検索結果ページ

タグ(/tag/)とサイト内検索結果ページは通常、次のような強い影響力を持つ。 SEO クロールの価値が低く、重複コンテンツを作成する傾向がある場合は、クロールを無効にすることができます:

不許可: /?s=

不許可: /tag/注:これらのページにnoindexが設定されている場合、クロールを保存して Googleサーチコンソール 警告「robots.txtによってクロールからブロックされたnoindexページ」。

5.robots.txt設定のベストプラクティス

- 実際の状況に基づいてルールを作成し、他人の設定を盲目的にコピーすることを避ける。

- 禁止しない カスケーディングスタイルシート JSファイルのクロールで、そうでなければ検索エンジンのページレイアウトとモバイル適応の評価に影響を与える。

- sitemap.xmlの送信と同時に、例えばrobots.txtにサイトマップリンクを追加する:

![画像[5]-Yoast SEO with robots.txt:クローラーのルールを正しく設定するには?](https://www.361sale.com/wp-content/uploads/2025/06/20250630194157501-image.png)

サイトマップ: https://www.yoursite.com/sitemap_index.xml

- 設定が完了したら、Google Search Consoleのrobots.txtテストツールを使って、期待に応えているかをチェックする。

- フィット ヨーストSEO ページのインデックス状態を柔軟に管理するためのnoindex設定

6.よくある設定エラー

- 誤ってサイト全体を不許可にしたため、サイトがインデックスされなくなった。

- wp-contentディレクトリのクロールを無効にしたため、スタイルとスクリプトのロードに例外が発生しました。

- robots.txtに依存してパスワード保護なしでプライベートコンテンツをブロックすることは、セキュリティ上のリスクがある。

概要

robots.txtは、ウェブサイトのSEO対策において無視できない基本的な部分であり、Yoast SEOのファイル編集機能を使えば、robots.txtを簡単に管理することができます。 robots.txtこの最新機能は、検索エンジンのクローラーを誘導する新しい方法で、クロール効率と全体的なSEOパフォーマンスを向上させる。

| お問い合わせ | |

|---|---|

| チュートリアルが読めない?無料でお答えします!個人サイト、中小企業サイトのための無料ヘルプ! |

カスタマーサービス WeChat

|

| ① 電話:020-2206-9892 | |

| ② QQ咨询:1025174874 | |

| 三 Eメール:info@361sale.com | |

| ④ 勤務時間: 月~金、9:30~18:30、祝日休み | |

この記事へのリンクhttps://www.361sale.com/ja/64022この記事は著作権で保護されており、必ず帰属表示を付けて複製してください。

![絵文字[wozuimei]-Photonflux.com|プロのWordPress修理サービス、ワールドワイド、迅速対応](https://www.361sale.com/wp-content/themes/zibll/img/smilies/wozuimei.gif)

![表情[baoquan]-光子波动网 | 専門WordPress修復サービス、全世界対応、迅速対応](https://www.361sale.com/wp-content/themes/zibll/img/smilies/baoquan.gif)

コメントなし